L’intelligenza artificiale è spesso raccontata come un acceleratore di progresso, capace di trasformare settori produttivi, migliorare la vita quotidiana e aprire nuovi orizzonti scientifici. Ma dietro l’entusiasmo tecnologico, l’IA si rivela anche come un potente fattore di disordine globale. La sua diffusione non solo altera equilibri economici e sociali, ma ridisegna le gerarchie di potere a livello planetario, sollevando interrogativi cruciali su chi realmente “comandi le macchine”: gli Stati, le Big Tech, o un intreccio inedito di forze che sfugge alle logiche tradizionali.

La ridefinizione delle gerarchie globali

La competizione tra Ovest e Oriente per la supremazia tecnologica ha assunto i tratti di una vera e propria “guerra fredda digitale”. Stati Uniti e Cina investono miliardi di dollari in ricerca e sviluppo, riconoscendo nell’IA un asset strategico al pari delle risorse energetiche o delle armi nucleari. L’Europa, invece, tenta di ritagliarsi un ruolo di regolatore globale, ponendo l’accento su diritti fondamentali, trasparenza e sostenibilità. Ne emerge un quadro multipolare, in cui il potere non si distribuisce più secondo linee esclusivamente geopolitiche, ma lungo assi tecnologici e infrastrutturali.

Stati e Big Tech: una convivenza ambivalente

La vera novità introdotta dall’IA è che gli Stati non sono più i soli protagonisti del gioco. Le grandi piattaforme digitali – da Google a Microsoft, da OpenAI a Tencent – si pongono come attori globali capaci di condizionare mercati, regolare l’accesso ai dati e influenzare opinioni pubbliche. Si tratta di un potere che travalica i confini nazionali, spesso più rapido ed efficace delle decisioni governative. Il rapporto tra Stati e Big Tech è quindi ambivalente: cooperazione quando serve, conflitto quando interessi divergenti minacciano la sovranità politica o economica.

Governance globale e vuoti normativi

La mancanza di un’architettura di governance globale dell’IA è uno degli elementi che alimentano il disordine. Ogni attore si muove secondo regole proprie: Washington privilegia l’innovazione e la sicurezza nazionale, Pechino coniuga sviluppo tecnologico e controllo sociale, Bruxelles investe sulla protezione dei diritti e sulla regolazione dei rischi. Tuttavia, senza standard comuni, il rischio è una frammentazione normativa che penalizza la cooperazione e rafforza la logica dei blocchi contrapposti. La sfida è creare spazi di convergenza capaci di impedire derive monopolistiche e conflitti tecnologici aperti.

Democrazia sotto pressione

In questo scenario, la democrazia si trova stretta tra due fuochi. Da un lato, l’uso dell’IA nei processi decisionali promette efficienza e ottimizzazione, ma riduce la trasparenza dei meccanismi politici e amministrativi. Dall’altro, la capacità degli algoritmi di manipolare informazioni e orientare il consenso mina le basi stesse del confronto democratico. Le elezioni influenzate dai deepfake, la profilazione elettorale e le campagne di disinformazione sono solo i primi segnali di una trasformazione che mette a rischio la sovranità popolare. La domanda è se i cittadini possano ancora contare su istituzioni in grado di difendere i loro diritti nell’era delle macchine.

Scenari futuri

Chi comanda davvero le macchine? Probabilmente nessuno in modo esclusivo. La realtà è che il potere si distribuisce tra Stati, imprese e reti transnazionali di dati e algoritmi. La capacità di governare l’IA non dipenderà solo dalle risorse economiche o militari, ma anche dalla forza normativa e dal consenso sociale. In gioco non vi è soltanto la leadership tecnologica, ma la definizione di un nuovo contratto globale che determinerà quanto spazio resterà alla democrazia, alla dignità umana e al pluralismo culturale.

Conclusione

Il disordine globale generato dall’intelligenza artificiale non è un incidente di percorso, ma il riflesso della natura stessa di questa tecnologia: ibrida, ubiqua, capace di ridisegnare gli equilibri più rapidamente di quanto i sistemi politici riescano ad adattarsi. La sfida del nostro tempo è quindi duplice: impedire che il potere algoritmico si concentri nelle mani di pochi, e costruire regole condivise che restituiscano all’IA una dimensione autenticamente al servizio dell’umanità. Solo così potremo rispondere alla domanda iniziale con una certezza: a comandare le macchine dovrebbero essere le persone, non il contrario.

Bibliografia essenziale

Kissinger, H., Schmidt, E., Huttenlocher, D., The Age of AI and Our Human Future, John Murray, 2021.

Creemers, R., China’s Social Credit System and AI Governance, Oxford University Press, 2023.

Russell, S., Human Compatible. Intelligenza artificiale e il problema del controllo, Bollati Boringhieri, 2020.

Floridi, L., Etica dell’intelligenza artificiale, Raffaello Cortina Editore, 2022.

European Commission, AI Act: Proposal for a Regulation on Artificial Intelligence, Bruxelles, 2021.

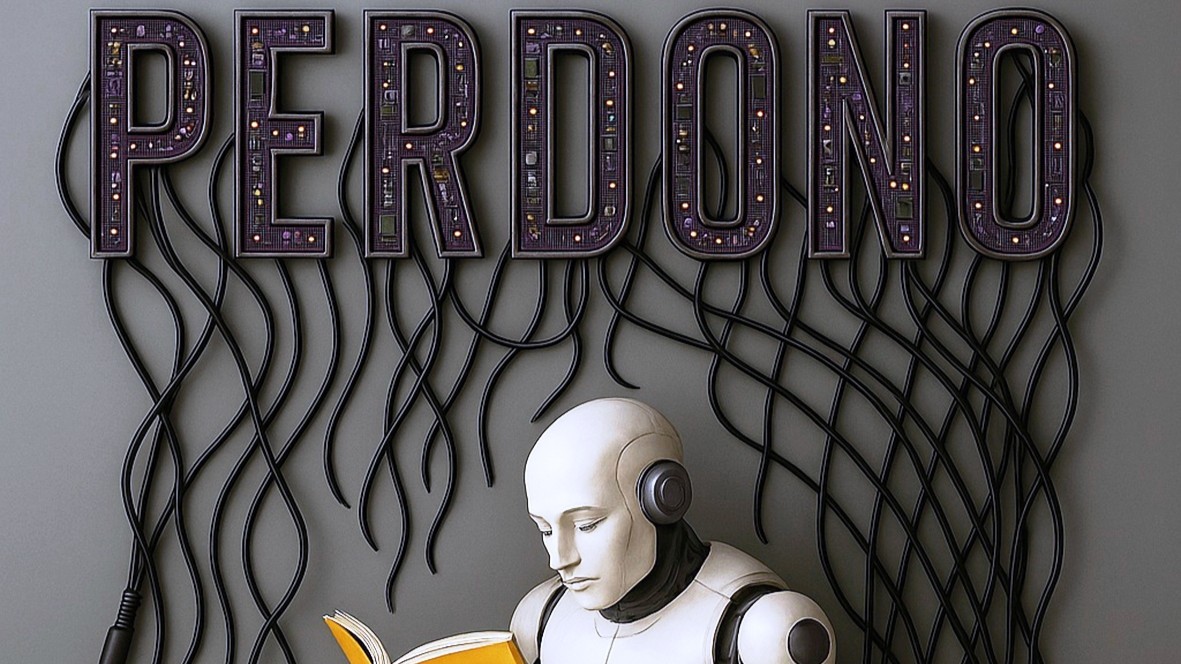

In copertina: Piero Barducci, Chi comanda le macchine? (2025)